L’absence d’erreurs humaines flagrantes dans un texte ne constitue plus une garantie d’authenticité. Certaines formulations excessivement neutres, une structure trop régulière ou l’accumulation de faits sans prise de position sont parfois des indices, mais ils ne suffisent plus à trancher.

Des outils spécialisés s’appuient désormais sur des signatures statistiques ou sur la reconnaissance de patterns linguistiques pour repérer la production d’une intelligence artificielle. Pourtant, des stratégies émergent pour brouiller ces pistes et rendre la traçabilité plus complexe, remettant en question la frontière entre texte humain et texte généré.

Pourquoi l’origine d’un texte ChatGPT suscite autant de questions aujourd’hui

Le contenu généré par ChatGPT s’invite dans tous les secteurs : rapports d’entreprise, blogs, articles scientifiques, devoirs scolaires… Rien n’y échappe. Cette omniprésence chamboule les repères établis et ébranle la notion d’authenticité, jusqu’à brouiller la ligne de démarcation entre texte rédigé par un humain et texte généré par intelligence artificielle. Chaque phrase bien lissée, chaque argument ciselé, laisse planer le doute : d’où ça vient, qui est derrière ? L’intelligence artificielle modèle le langage, mais brouille aussi les pistes de son intervention.

La prolifération des textes générés par ChatGPT inquiète dans les milieux universitaires, juridiques, et médiatiques. Le spectre du plagiat ou de la manipulation de contenus non attribuables ne relève plus de l’hypothèse théorique. Dans le secteur du SEO, la question de la légitimité des textes optimisés par des machines occupe tous les esprits. Face à cette vague, les moteurs de recherche réajustent déjà leurs algorithmes pour repérer la signature d’un texte généré, quitte à rétrograder certains sites.

Cette omniprésence suscite une soif d’outils capables de détecter ChatGPT. Enseignants, juristes, spécialistes cybersécurité : chacun cherche la parade, le protocole fiable pour remonter à l’origine du contenu. Comment savoir si un texte a été généré par ChatGPT ? Quels signaux surveiller ? Les réponses se dérobent, car la technologie avance à une telle vitesse que la frontière entre création humaine et contenu généré devient chaque jour plus floue.

Reconnaître un contenu généré par l’IA : indices, méthodes et outils incontournables

Identifier un texte généré par ChatGPT relève aujourd’hui d’un vrai casse-tête. Les frontières entre style humain et écriture algorithmique s’effacent peu à peu. Premier terrain d’enquête : la syntaxe. Phrases longues, parfaitement structurées, quasi irréprochables, voilà un signe possible de génération automatisée. Les contenus produits par l’IA affichent souvent une neutralité lexicale, un ton policé, sans grandes prises de position. On repère aussi la répétition de certaines structures, le recours systématique à des reformulations. Autant de détails qui renseignent l’œil averti.

Certains indices dans le contenu peuvent mettre la puce à l’oreille :

- Uniformité dans le rythme des phrases : la monotonie s’installe, absence de variations stylistiques notables.

- Usage de connecteurs logiques abondants : l’IA raffole des « cependant », « effectivement » ou « par ailleurs ».

- Manque d’exemples concrets ou d’anecdotes personnelles : le propos reste général, sans aspérité ni vécu.

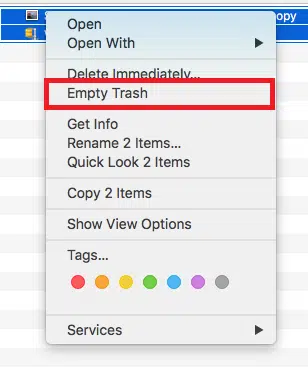

Face à ces challenges, les outils de détection se multiplient. Turnitin, acteur historique de la détection du plagiat, s’est doté de modules capables d’identifier les passages générés par GPT. Des solutions comme Draft Goal analysent la probabilité qu’un texte soit généré par une IA, combinant analyse statistique, détection de schémas récurrents et comparaison avec des corpus écrits par des humains. Certains outils mettent en avant une visualisation des segments suspects, pour faciliter la relecture et l’évaluation critique.

Mais rien n’est infaillible : une reformulation astucieuse peut brouiller les pistes et déjouer les analyses automatiques. L’expertise humaine garde donc tout son poids, croisant le flair et la méthode pour traquer les textes générés par l’IA.

Peut-on vraiment rendre un texte ChatGPT indétectable ? Astuces et limites à connaître

Certains tentent de faire passer un texte généré par ChatGPT pour une œuvre originale en misant sur des outils de reformulation ou de paraphrase automatisée. Des services comme Quillbot ou Hix Bypass promettent de métamorphoser un contenu d’IA pour lui donner une allure plus humaine. Leur stratégie : injecter de la diversité, modifier la structure, semer quelques maladresses volontaires ou des tournures inattendues. Mais ces ruses atteignent rapidement un plafond.

Les algorithmes de détection deviennent plus affûtés. Ils repèrent l’uniformité, l’absence de relief personnel, les signatures lexicales typiques de l’IA. Même un texte « humanisé » conserve des traces : une cohérence trop parfaite, une neutralité persistante, le manque d’exemples frappants ou d’erreurs contextuelles, ces petites failles qui signent une plume humaine.

Voici quelques leviers généralement actionnés pour tenter de masquer l’origine d’un texte :

- Humanisation du texte : insérer des anecdotes, jouer sur la cadence, glisser des références concrètes.

- Outil de reformulation : utile en surface, mais vite dépassé dès qu’une analyse approfondie se met en place.

Créer un contenu ChatGPT tout en le dissimulant soulève une contradiction : plus on force la dissimulation, plus les incohérences apparaissent. Un texte rédigé par un humain s’autorise les hésitations, les imperfections, les touches d’expérience. Les outils comme Turnitin exploitent la comparaison à grande échelle pour repérer les indices de génération que la simple reformulation ne suffit pas à effacer.

Utiliser l’intelligence artificielle en rédaction : enjeux, responsabilités et bonnes pratiques

La rédaction assistée par intelligence artificielle change la donne dans la création de texte. Les outils d’OpenAI et d’autres acteurs offrent une production rapide, volumineuse, mais ne dispensent jamais d’une vraie réflexion éthique. Derrière chaque contenu généré se pose la question de la fiabilité et de l’authenticité, surtout dans les secteurs où la précision est de mise.

Publier sur un blog ou rédiger des articles à l’aide de ces technologies suppose un vrai contrôle des risques liés à la désinformation. Rien ne remplace la relecture humaine. Relisez systématiquement chaque texte généré, corrigez les imprécisions, vérifiez les sources, adaptez le ton au lectorat visé. La responsabilité éditoriale ne se transfère pas à la machine.

Les habitudes évoluent, mais certaines pratiques restent incontournables :

- Indiquez clairement l’utilisation d’outils d’intelligence artificielle quand la situation l’exige.

- Surveillez la cohérence et la véracité du contenu, notamment pour le SEO ou les publications destinées à un usage professionnel.

- Misez sur une écriture hybride : combinez l’automatisation et l’apport personnel de l’auteur.

La prudence reste de mise : généraliser l’usage de l’intelligence artificielle OpenAI risque d’uniformiser les textes et de gommer la singularité des voix. La valeur d’un contenu, même optimisé pour le référencement, ne réside jamais dans la seule technique : elle tient à la profondeur de l’analyse et à la personnalité qui transparaît. La frontière entre texte humain et texte généré n’a jamais été aussi ténue, et c’est précisément là que tout se joue.